JAX prend le volant pour l'IA haute performance

L'une de mes sessions préférées à Google Cloud Next '24 portait sur le cadre JAX. JAX est un framework Python pour le calcul de tableaux orienté accélérateur et la transformation de programmes, conçu pour le calcul numérique à haute performance et l'apprentissage automatique à grande échelle. Il est construit au-dessus de NumPy, ce qui facilite son adoption par NumPy. Le framework est spécialement conçu pour utiliser la puissance des GPU et des TPU afin d'accélérer les processus d'apprentissage d'un modèle - il surpasse Tensorflow et PyTorch dans ce domaine particulier. Avec JAX, nous pouvons moderniser le code ML et exploiter le matériel de la plateforme GCP pour faire passer le développement de modèles à un niveau supérieur !

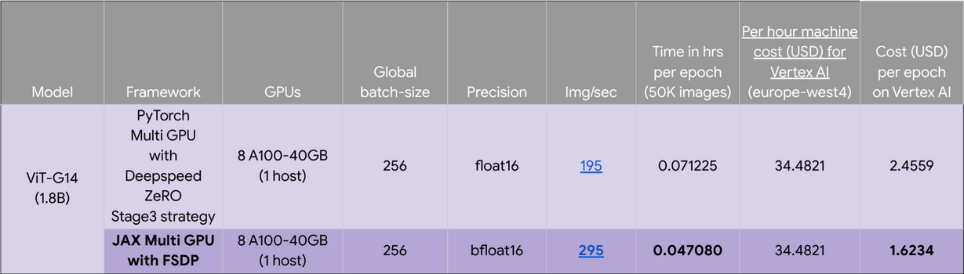

Image source : https://github.com/GoogleCloudPlatform/vertex-ai-samples/blob/main/community-content/vertex_model_garden/benchmarking_reports/jax_vit_benchmarking_report.md#benchmarking-results

Embeddings Unleashed : Comprendre le monde, un vecteur à la fois

Les Embeddings sont un moyen de stocker des données qui capturent les relations et le sens sous-jacent du texte. Ils jouent un rôle crucial dans diverses applications d'intelligence artificielle, en particulier dans le traitement du langage naturel, qui aide les ordinateurs à comprendre les nuances du langage humain. Les embeddings sont désormais disponibles dans toutes les bases de données, ce qui constitue une avancée significative. En outre, il est désormais possible d'exploiter la puissance de la recherche avec des encastrements multimodaux. Cette évolution nous permettra d'intégrer plus facilement les embeddings dans leurs flux de travail et de libérer tout leur potentiel pour diverses tâches telles que l'analyse des sentiments, la recherche vectorielle ou les systèmes de recommandation.

Enrichissez votre application avec l'IA multimodale de Gemini

Lors de Next '24, Google a fait une annonce passionnante à propos de son aperçu de Gemini AI 1.5. Gemini AI est un modèle d'IA générative multimodale qui permet de traiter des images, de l'audio, des vidéos, du texte, des PDF, et qui prend en charge jusqu'à 1 million de jetons d'entrée ! Même s'il était déjà révolutionnaire auparavant, ces nouvelles capacités rendent Gemini encore plus convaincant lorsqu'il s'agit de cas d'utilisation spécifiques pour des applications telles que le résumé. Par exemple, Gemini peut maintenant fournir des informations et résumer des documents, des images, des vidéos et des fichiers audio. Grâce à ces nouvelles mises à jour, nos équipes sont en mesure d'utiliser Gemini AI pour extraire un large éventail de déductions à partir de diverses sources de données ! Gemini AI peut décrire une image ou une vidéo avec différents niveaux de détail ; par exemple, il peut renvoyer des chapitres avec des horodatages à partir de fichiers vidéo et audio. Nous ne sommes pas limités aux cas d'utilisation mentionnés ; les cas d'utilisation de Gemini AI sont apparemment infinis ! Notre équipe s'appuiera sur des technologies telles que Gemin AI pour aider à développer des solutions de pointe pour nos clients.

Opérationnaliser l'IA générative

J'ai également assisté à une excellente démonstration qui a permis de mieux comprendre les flux de travail GCP et les modèles d'IA générative. Workflows est un outil d'orchestration GCP qui permet de développer des pipelines ML, des processus métier et des microservices. Chacun de ces workflows peut être décrit facilement à l'aide d'un fichier YAML. Workflows utilise des connecteurs pour faire appel à une multitude de services GCP - désormais, il dispose également de connecteurs pour appeler directement les API de Generative AI. Cette innovation permettra aux applications de s'intégrer sans effort à l'un des LLM les plus avancés - Gemini AI.

Un paysage de l'IA transformé

Les nouvelles annonces de Google Cloud sur le développement de l'IA sont tout simplement incroyables. JAX donne du pouvoir aux développeurs, embeddings permet de mieux comprendre vos données, la multimodalité de Gemini AI ouvre de nouveaux horizons pour travailler avec une variété de sources de données, et l'utilisation de Workflows avec Gen AI libère une nouvelle vague de possibilités créatives. En utilisant ces technologies, Improving peut développer sur GCP des applications innovantes, modernes et basées sur l'IA qui aident nos clients à résoudre leurs défis opérationnels et stratégiques. L'avenir de l'IA est prometteur, et Google Cloud est à l'avant-garde de ce voyage passionnant !